猫头鹰的天敌是什么?最小猫头鹰仅15厘米长(最怕金雕)

文章编号:79

2024-01-19

猫头鹰存在多个种类,其中大型猫头鹰如雪鸮和雕鸮往往没有太多天敌,它们常处于食物链的顶端。中小型猫头鹰大部分情况下都有天敌,比如金雕和大鵟等猛禽会以它们为食。

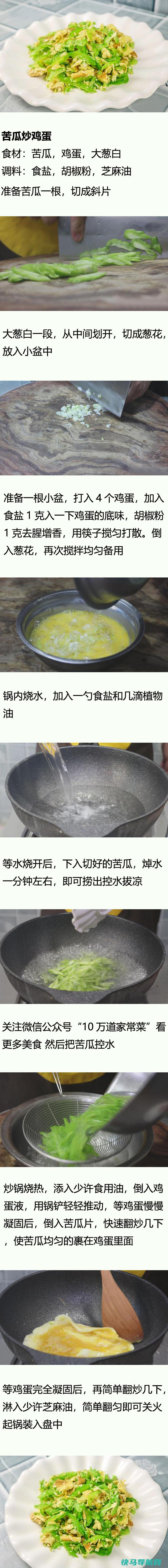

猫头鹰属于猛禽类鸟类的一种。一些大型品种几乎占据了食物链的顶端地位,例如雪鸮体长可达60-70厘米,相当于一只大型犬。它们常年以野兔、鸭子等为食,因此天敌相对较少。在猫头鹰中也有小型品种,比如领鸺鹠,成年后只有不到15厘米长,仅相当于一只小型兔子的大小,这类猫头鹰的天敌更多一些。

大型猫头鹰大多以小到中型哺乳动物为食,且主要在夜晚活动。因此,它们基本上没有天敌。但有一种大型猫头鹰是例外,那就是雪鸮。雪鸮白天和晚上都会觅食,而且它们主要栖息在北极地区。所以,雪鸮也有天敌,只是比较少。在白天,雪鸮需要防备北极狐、贼鸥、雪狼以及狗等的侵袭,甚至包括人类,尤其是在繁殖期间,雄性雪鸮会变得极为小心以保护蛋。如果不是繁殖期,雪鸮的勇气会更大一些。因为没有顾虑,它们经常与大型猛禽争夺猎物,如金雕和游隼,甚至是狼和北极狐,它们都毫不惧怕,甚至会将它们赶出自己的领地,仿佛与世界上最嚣张的动物——蜜獾一样。

与大型猫头鹰相比,小型猫头鹰更加危险,尤其是体型最小的猫头鹰——领鸺鹠。它的体长只有15厘米,甚至不及一只狗。因此,它的天敌是一些大型猛禽,如金雕。尽管领鸺鹠是白天觅食的,但它通常栖息在高大的乔木上,以躲避大型掠食者,它们主要以树上的果实、昆虫、哺乳动物甚至鸟类为食。

手机制作视频软件 有小额贷款影响征信吗 吃康宝莱会卵巢早衰么 一天一万步可以减肥吗 大蒜软胶囊 污兔软件 鹿晗属什么生肖 qq贷款平台本文地址: https://www.q16k.com/article/38b417c8bdac1e6632e7.html